Gemini ‘vede’ il mondo: l’integrazione dell’IA negli smartphone

Google ha annunciato l’avvio del rilascio di nuove e rivoluzionarie funzionalità di intelligenza artificiale per il suo chatbot, Gemini. Questa innovazione permetterà a Gemini di interagire con il mondo reale attraverso la fotocamera e lo schermo degli smartphone, aprendo nuove frontiere nell’assistenza virtuale. Un portavoce di Google ha confermato a The Verge che questa opzione è simile alla modalità avanzata di ChatGpt, svelata da OpenAI alla fine del 2024.

L’aggiornamento di Gemini giunge a quasi un anno di distanza dalla dimostrazione di Project Astra, un ambizioso progetto di ricerca di Big G volto a sviluppare un assistente IA universale avanzato. Questa nuova implementazione rappresenta un passo significativo verso la realizzazione di un’intelligenza artificiale in grado di comprendere e interagire con l’ambiente circostante in modo intuitivo e contestuale.

Gemini Live: conversazioni più naturali e interattive

Le nuove funzioni di Gemini sono state scoperte grazie a segnalazioni sui forum di Reddit, dove un utente, apparentemente in possesso di un telefono Xiaomi, ha avuto accesso anticipato alle funzionalità di visione. Queste novità si integrano con Gemini Live, la modalità che permette all’assistente di Google di intrattenere conversazioni più naturali e fluide con gli utenti.

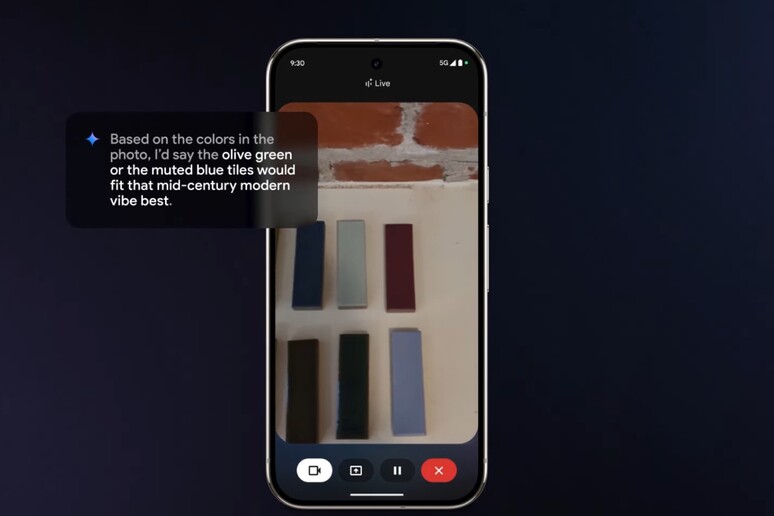

Le principali innovazioni si concentrano in due aree chiave: la lettura dello schermo e l’interpretazione dei flussi video in diretta. La prima consente al chatbot di analizzare e rispondere a domande relative a ciò che viene visualizzato sul display del dispositivo, aprendo nuove possibilità per l’assistenza contestuale. Immaginate di poter chiedere a Gemini di riassumere un articolo che state leggendo o di aiutarvi a compilare un modulo online. La seconda, ancora più rivoluzionaria, permette all’IA di ‘leggere’ i flussi video provenienti dalla fotocamera dello smartphone in tempo reale, fornendo risposte e suggerimenti basati su ciò che vede.

Esempi pratici: dall’arte alla vita quotidiana

Un esempio pratico di questa tecnologia è l’utilizzo di Gemini per ricevere consigli sulla scelta del colore di vernice per un oggetto in ceramica. Immaginate di puntare la fotocamera del vostro smartphone verso una tavolozza di colori e chiedere a Gemini quale tonalità si adatta meglio al vostro progetto artistico. L’IA analizzerebbe l’immagine e vi fornirebbe suggerimenti personalizzati, tenendo conto del tipo di ceramica, dello stile desiderato e delle tendenze del momento.

Ma le applicazioni di Gemini non si limitano all’arte e all’hobbistica. Questa tecnologia potrebbe essere utilizzata per ricevere assistenza in cucina, per identificare oggetti sconosciuti, per tradurre cartelli stradali in lingue straniere o per ottenere informazioni su prodotti e servizi semplicemente inquadrandoli con la fotocamera del telefono.

Disponibilità e abbonamenti

Google ha iniziato a distribuire entrambe le funzionalità agli abbonati Gemini Advanced come parte del piano Google One AI Premium. Questo significa che, per il momento, solo gli utenti che sottoscrivono questo abbonamento potranno beneficiare delle nuove capacità di visione di Gemini. Tuttavia, è lecito aspettarsi che, in futuro, queste funzionalità vengano estese anche ad altri piani di abbonamento o rese disponibili gratuitamente a tutti gli utenti.

Il futuro dell’assistenza virtuale è già qui

L’integrazione della visione artificiale in Gemini rappresenta un passo avanti significativo nel campo dell’intelligenza artificiale e dell’assistenza virtuale. Questa tecnologia promette di trasformare il modo in cui interagiamo con i nostri dispositivi e con il mondo che ci circonda, aprendo nuove possibilità per l’apprendimento, la creatività e la risoluzione dei problemi. Tuttavia, è importante considerare anche le implicazioni etiche e sociali di questa tecnologia, in particolare per quanto riguarda la privacy e la sicurezza dei dati personali.

, dove curiosità

, dove curiosità  e innovazione

e innovazione  navigano insieme alla velocità della luce

navigano insieme alla velocità della luce  .

.