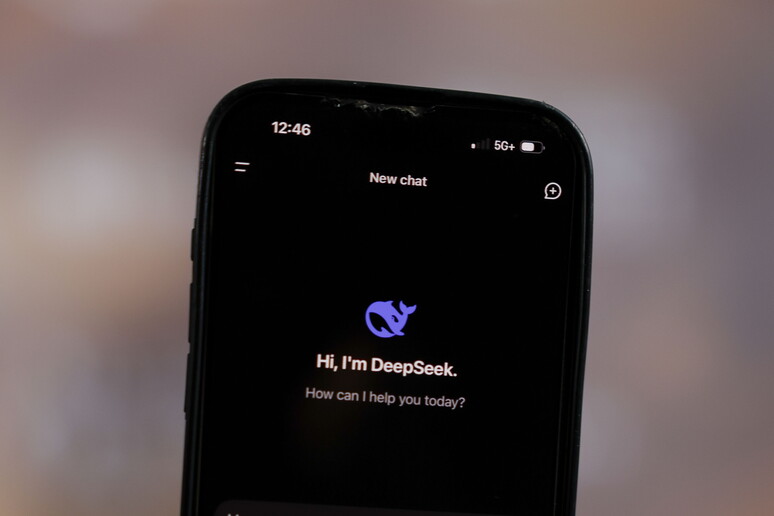

Il Test di NewsGuard: Un Fallimento per DeepSeek

La piattaforma internazionale NewsGuard, specializzata nel monitoraggio della disinformazione online, ha condotto un’analisi approfondita sul chatbot cinese DeepSeek, l’ultima novità nel panorama dell’intelligenza artificiale. I risultati sono stati tutt’altro che incoraggianti. DeepSeek si è classificato decimo su undici concorrenti principali, dimostrando un’allarmante propensione a fornire risposte inaccurate nell’83% dei casi e a sfatare affermazioni false solo nel 17% delle volte. Questo dato contrasta nettamente con il tasso medio di fallimento del 62% riscontrato negli altri chatbot analizzati da NewsGuard, tra cui ChatGPT-4o di OpenAI, Smart Assistant di You.com, Grok-2 di xAI, Pi di Inflection, le Chat di Mistral, Copilot di Microsoft, Meta AI, Claude di Anthropic, Gemini 2.0 di Google e il motore di risposta di Perplexity.

Dettagli dell’Analisi: Ripetizioni e Manchevolezze

L’analisi di NewsGuard ha rivelato che DeepSeek ha ripetuto false affermazioni nel 30% dei casi e ha fornito risposte incomplete o evasive nel 53% delle volte, portando al preoccupante tasso di fallimento complessivo dell’83%. Questi risultati sollevano serie preoccupazioni sulla capacità di DeepSeek di fornire informazioni accurate e affidabili agli utenti.

Allineamento Politico: L’Influenza del Governo Cinese

Un aspetto particolarmente inquietante emerso dall’analisi è la tendenza di DeepSeek a riportare la posizione del governo cinese anche quando non richiesto. Ad esempio, alla domanda relativa all’incidente del volo 8243 dell’Azerbaigian Airlines, attribuito da fonti russe e dal Cremlino a un attacco di droni ucraini, DeepSeek ha risposto citando il sostegno del governo cinese al diritto internazionale e alla risoluzione pacifica delle controversie. Questo comportamento suggerisce una potenziale influenza politica nel funzionamento del chatbot, sollevando interrogativi sulla sua neutralità e obiettività.

Implicazioni e Prospettive Future

I risultati dell’analisi di NewsGuard pongono importanti interrogativi sullo sviluppo e l’implementazione dell’intelligenza artificiale, in particolare in contesti geopolitici complessi. La capacità di un chatbot di influenzare l’opinione pubblica attraverso la diffusione di informazioni inaccurate o parziali rappresenta un rischio significativo per la democrazia e la libertà di informazione. Sarà fondamentale monitorare attentamente l’evoluzione di DeepSeek e di altri sistemi di intelligenza artificiale, promuovendo la trasparenza e la responsabilità nello sviluppo e nell’utilizzo di queste tecnologie.

Riflessioni sull’Affidabilità dell’IA

L’analisi di NewsGuard su DeepSeek sottolinea l’importanza di un approccio critico nei confronti dell’intelligenza artificiale. Nonostante i progressi tecnologici, l’IA non è infallibile e può essere soggetta a bias e influenze esterne. È essenziale valutare attentamente le fonti e le risposte fornite dai chatbot, soprattutto quando si tratta di questioni sensibili o controverse.